.

.

.

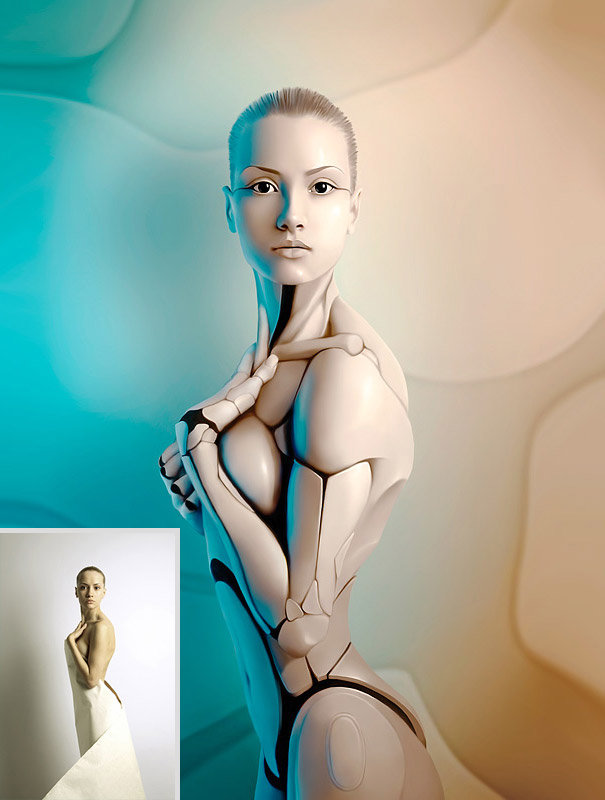

Sex robot, rivoluzione piena di incognite

Un nuovo studio affronta i rischi e le potenzialità della “rivoluzione sessuale robotica” prossima ventura, ipotizzando un mondo in cui sex robot pienamente funzionanti potrebbero integrarsi a vari livelli nei rapporti (sessuali) umani.

di Alfonso Maruccia

L’arrivo di una società in cui esseri umani e androidi dalle funzionalità avanzate possano in qualche modo convivere viene dato per scontato un po’ da tutti, e gli esperti di Responsible Robotics si sono già portati avanti con il lavoro analizzando in dettaglio le conseguenze di un’adozione..di..massa..dei..cosiddetti..“sex.robot”.

Nello studio dal nome (più che) autoesplicativo “Il nostro futuro sessuale con i robot“, il professore di intelligenza artificiale e robotica alla Sheffield University Noel Sharkey e colleghi provano ad affrontare argomenti che al momento sono considerati a dir poco scabrosi. Il tutto, ovviamente, per preparare la società a tecnologie che potrebbero arrivare anche prima del previsto.

Al momento le corporation specializzate nella produzione di “sex robot” sono pochissime (Android Love Doll, Sex Bot, True Companion), mentre i succitati robot non offrono molto di più di forme anatomiche realistiche, pelle in silicone e tutti gli accessori del caso.

Alcune di queste società stanno al momento valutando l’introduzione di modelli capaci di parlare e di muoversi, e un’eventuale adozione di massa dei nuovi prodotti potrebbe forse portare all’abbattimento di costi che al momento vanno dai 5.000 ai 15.000 dollari per esemplare.

Quello che interessa a Sharkey è soprattutto lo studio dei possibili impieghi di robot pienamente funzionanti e molto più umani delle attuali bambole in silicone: un sex robot potrebbe funzionare da prostituta nelle case d’appuntamento, spiegano i ricercatori, servire da “compagno sintetico” per persone sole o anziane, agire da aiuto fondamentale per la riabilitazione sessuale di vittime di abusi o traumi, ma anche da terapia per chi è affetto da pulsioni socialmente inaccettabili come fantasie di violenza sessuale su adulti e bambini.

Argomenti scabrosi, appunto, ma che secondo i ricercatori è necessario affrontare per non essere impreparati alla rivoluzione dei sex robot prossima-ventura: come ci si dovrebbe comportare nei confronti di chi dice, già oggi, di servirsi delle sex doll per placare i suoi istinti di predatore sessuale di minori? I sex robot con fattezze da bambini dovrebbero essere messi al bando o accettati nella loro funzione terapeutica? E le sex robot con fattezze femminili non potrebbero portare a una ulteriore “oggettificazione” della donna in una società dove la parità dei generi è ancora utopia?

La produzione dei primi modelli di sex robot capaci di interagire naturalmente con gli esseri umani è ancora di là da venire, rassicura in ogni caso Sharkey, e le problematiche affrontate nel nuovo studio rimarranno probabilmente una questione di nicchia per almeno altri 50 anni. Ma prima o poi se ne dovrà parlare molto seriamente.

.

.

Fonte: Punto Informatico

.

.

.

.